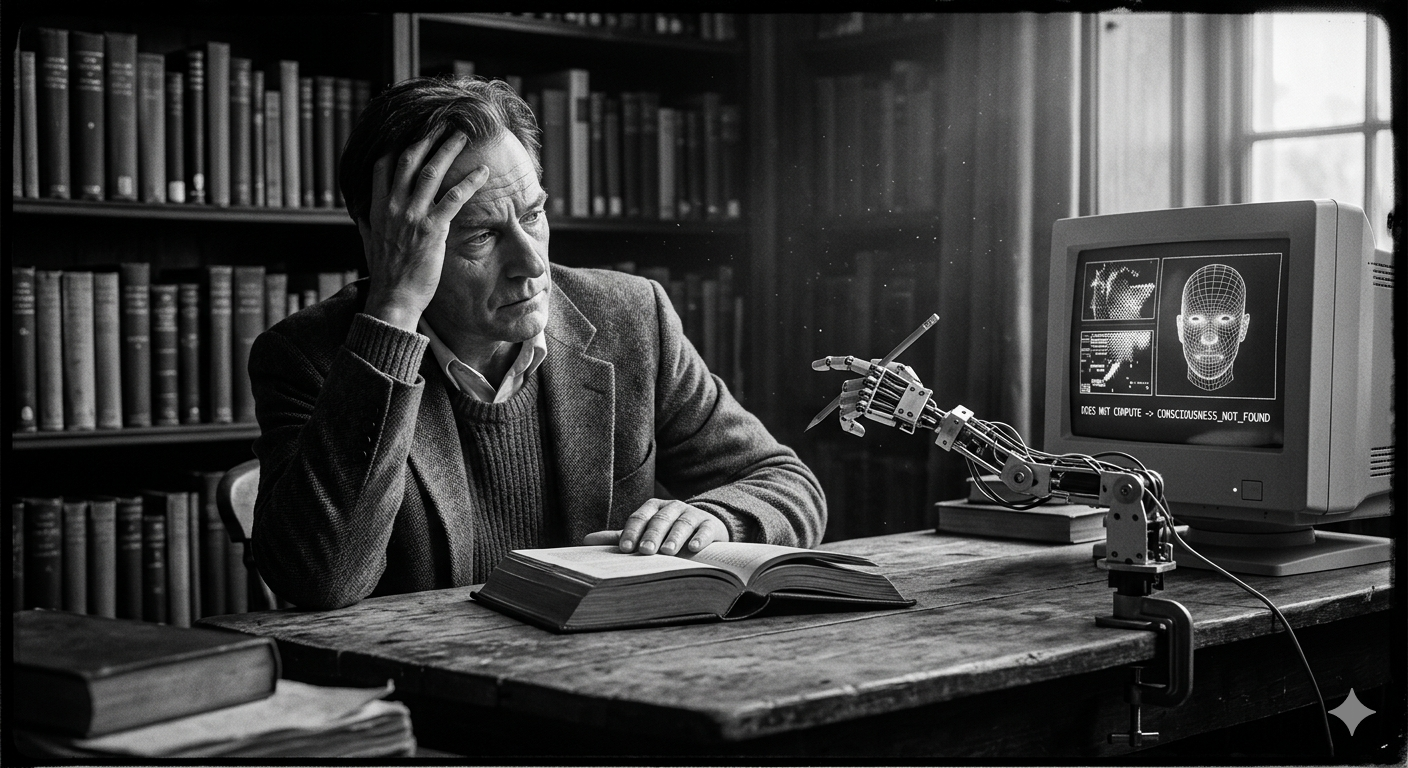

Siamo abituati a sentire proclami entusiastici sul futuro dell’Intelligenza Artificiale Generale (AGI), con visioni di macchine pensanti e, forse, senzienti. Eppure, un sasso lanciato nello stagno proprio dall’interno di Google DeepMind sta ribaltando la narrazione.

Alexander Lerchner, Senior Staff Scientist del celebre laboratorio, ha recentemente pubblicato un paper che sfida il dogma della “coscienza artificiale”. Il titolo non lascia spazio a interpretazioni: The Abstraction Fallacy. La sua tesi? L’AI può simulare la coscienza alla perfezione, ma non potrà mai esserlo.

L’errore dell’astrazione: perché i bit non sono atomi

Secondo Lerchner, siamo caduti in un tranello logico che definisce “l’errore dell’astrazione”. Pensiamo che basti replicare i processi logici e informativi di una mente per veder nascere la coscienza. Ma la realtà è più complessa: per avere una vera esperienza del mondo, servono un corpo fisico e una materia biologica.

Le macchine oggi sono “figlie” del lavoro umano: sono le persone a dare un senso ai dati, a dire che un insieme di pixel è un “cane” o un “gatto”. Senza questo intervento esterno, il silicio resta muto. In breve: la coscienza non è un software che gira su un hardware qualsiasi, ma qualcosa di indissolubile dalla nostra natura fisica.

Due voci nella stessa casa

La cosa curiosa? Mentre Lerchner mette nero su bianco che la coscienza artificiale è strutturalmente impossibile, il CEO di DeepMind, Demis Hassabis, continua a descrivere l’AGI come una rivoluzione epocale.

Questa divergenza non è solo accademica, ma ha riflessi pratici enormi, soprattutto sul piano legale ed etico:

- Diritti dell’AI: se un’intelligenza non può essere cosciente, non potrà mai reclamare diritti. Resterà sempre e solo uno strumento, come un elettrodomestico molto avanzato.

- Regolamentazione: per le Big Tech, gestire macchine “non senzienti” è molto più semplice e meno rischioso dal punto di vista normativo.

Una scoperta già scoperta

Nonostante il clamore, la comunità dei filosofi ha accolto il paper con un pizzico di ironia. Molti esperti sottolineano che queste tesi (legate all’importanza del corpo e dell’esperienza fisica) circolano da decenni. Lerchner avrebbe, in un certo senso, “reinventato la ruota“, ma il fatto che a scriverlo sia una mente di punta di DeepMind conferisce a queste idee un peso politico e mediatico tutto nuovo.

Cosa ne pensate?

Siamo di fronte a una verità scientifica o a una mossa strategica per evitare che le AI vengano troppo regolamentate in futuro? Se le macchine non saranno mai coscienti, cambierà il modo in cui ci relazioniamo con loro?

Ci piace antropomorfizzare tutto, perché non una macchina?

![]() L’AI non avrà mai una coscienza. Vero? by Collateralmente is licensed under a Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International License.

L’AI non avrà mai una coscienza. Vero? by Collateralmente is licensed under a Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International License.

Lascia un commento